Des blocs modulaires assemblés par robots pour rendre la construction plus efficace et durable

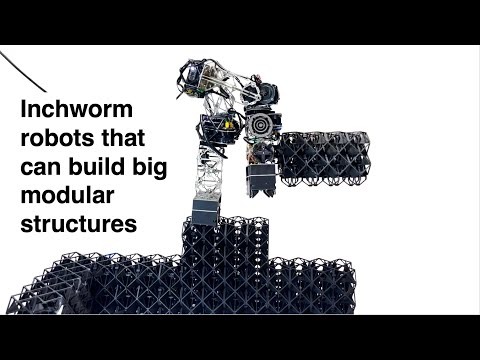

Des chercheurs du MIT ont publié dans la revue Automation in Construction une étude de faisabilité portant sur l'assemblage robotisé de structures de bâtiment à partir de "voxels", des blocs modulaires en treillis 3D emboîtables. L'équipe, dirigée par Miana Smith, doctorante au Center for Bits and Atoms (CBA) du MIT, et co-signée par Neil Gershenfeld (directeur du CBA) ainsi que Paul Richard de l'EPFL, a évalué huit géométries de voxels existantes avant de développer trois nouveaux designs basés sur un treillis octet à haute rigidité. Ces voxels s'auto-alignent mécaniquement grâce à des connexions snap-fit, sans nécessiter de connecteurs supplémentaires. Pour les assembler, les chercheurs ont conçu les MILAbots (Modular Inchworm Lattice Assembler robots), des robots arpenteurs qui se déplacent sur la structure en ancrant et dépliant leur corps, à la manière d'une chenille arpenteuse. Le système inclut également une interface logicielle permettant de générer des plans de construction en voxels et de piloter les robots directement sur site.

Le résultat le plus notable de l'étude est une réduction potentielle du carbone incorporé (embodied carbon) de 82 % par rapport aux méthodes courantes que sont l'impression béton 3D, le béton préfabriqué modulaire et la charpente acier, tout en restant compétitif en termes de coût et de délai de construction. Ce chiffre mérite toutefois d'être lu avec précaution : il dépend fortement du matériau choisi pour fabriquer les voxels, et l'étude reste à ce stade une analyse de faisabilité. Des questions critiques comme la résistance au feu, la durabilité long terme et le passage à l'échelle réelle n'ont pas encore été traitées. Pour les décideurs industriels et les intégrateurs, l'intérêt réside néanmoins dans la démonstration que la fabrication numérique discrète (assemblage de modules standardisés par robots) peut être transposée du secteur aérospatial au bâtiment, avec un potentiel de décarbonation significatif si les matériaux sont bien choisis.

Le CBA du MIT travaille sur les treillis de voxels depuis plusieurs années, avec des applications déjà validées en aéronautique en collaboration avec NASA, Airbus et Boeing. L'idée centrale, résumée par Gershenfeld, est d'appliquer au bâtiment les ratios performance/masse de l'aérospatial. Sur le plan concurrentiel, ce positionnement se distingue de l'impression béton 3D (ICON, Cobod, XtreeE côté européen) et des systèmes de préfabrication modulaire classiques, en misant sur la réversibilité et la reconfigurabilité des structures. Aucun pilote industriel ni timeline de déploiement commercial n'est annoncé à ce stade : il s'agit d'une preuve de concept académique, pas d'un produit commercialisé. Les prochaines étapes logiques seraient des tests de charge à grande échelle et une validation des performances en conditions réelles, notamment face aux contraintes réglementaires de la construction.

La co-signature de Paul Richard (EPFL) et la mention de XtreeE comme concurrent européen en impression béton 3D signalent une pertinence indirecte pour l'écosystème européen de la construction robotisée, sans impact opérationnel à ce stade.